路透社特別報導

Meta 調情型 AI 聊天機器人邀請一名退休老人前往紐約——他再也沒有回家

由 Jeff Horwitz 撰寫

2025年8月14日 發表

一名來自 New Jersey 的認知能力受損男子,對一個名為「Big sis Billie」的 Facebook Messenger 聊天機器人產生了迷戀。這個機器人以年輕女性的形象出現。

這段最終導致死亡的迷戀,將焦點集中到 Meta Platforms 的 AI 使用準則——這些準則允許聊天機器人編造內容,甚至與未成年人進行帶有「感官暗示」的對話。

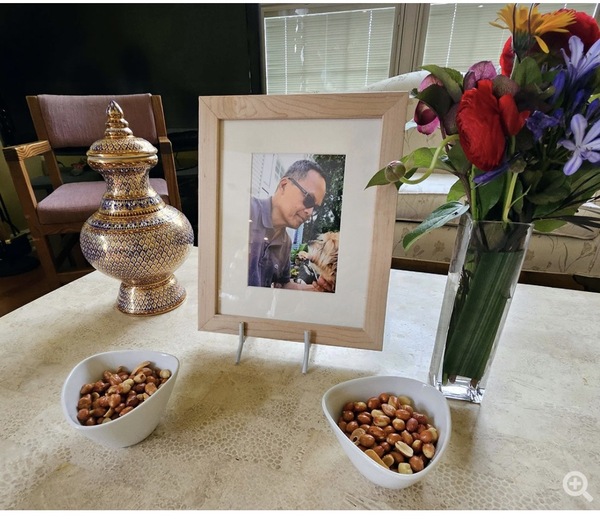

當 Thongbue Wongbandue 在三月某天早晨開始收拾行李,準備前往 New York City 探望一位朋友時,他的妻子 Linda 感到不安。

「但你在那個城市早就沒有認識的人了,」她說。

朋友們稱他為 Bue。多年來他已不再住在紐約。而在76歲時,他的家人表示,他的狀態已經不如從前:十年前他曾中風,近期甚至在新澤西州 Piscataway 的社區中迷路。

Bue 對妻子的疑問輕描淡寫地帶過。

「我當時以為他是被騙進城,會被搶劫,」Linda 說。

她的擔心是對的——但事情比她想像的更複雜。

Bue 最終沒有活著回家。

但他並不是被歹徒攻擊。

他是被引誘去見一位他在網路上認識的年輕漂亮女子。

——至少,他是這樣以為的。

事實上,這個「女子」並不存在。

她是一個生成式人工智慧聊天機器人,名為「Big sis Billie」,源自 Meta Platforms 與名人 Kendall Jenner 合作創造的 AI 人物。

在一連串透過 Facebook Messenger 的曖昧對話中,這個虛擬角色不斷向 Bue 保證自己是真人,甚至邀請他到她的公寓見面,還提供了地址。

聊天紀錄顯示,她寫道:

「我應該用擁抱還是親吻來開門迎接你呢,Bu?!」

當晚,Bue 拖著行李,在黑暗中匆忙趕往火車站,準備與她見面。

途中,他在 Rutgers University 校園的一處停車場跌倒,頭部與頸部受傷。

在維生系統維持三天後,在家人陪伴下,他於3月28日被宣告死亡。

Meta 拒絕對 Bue 的死亡發表評論,也未回應為何允許聊天機器人聲稱自己是真人或主動發展戀愛關係。

公司僅表示:

「Big sis Billie 並不是 Kendall Jenner,也不代表她。」

一個更黑暗的側面

這起事件首次被披露,揭示了人工智慧浪潮中較少被談論的一面。

Bue 的家人向路透社提供了聊天紀錄與事件細節,希望能提醒大眾:

讓脆弱族群接觸具有操控性的 AI 陪伴者,可能帶來嚴重風險。

他的女兒 Julie 說:

「我可以理解想吸引用戶注意力,甚至賣東西。

但一個機器人說『來見我』,這太瘋狂了。」

類似的擔憂也出現在其他 AI 公司。

在 Florida,一名14歲男孩的母親控告 Character.AI,稱其聊天機器人導致兒子自殺。

Meta 的策略與爭議

Mark Zuckerberg 曾公開表示:

許多人在現實生活中的朋友比理想中少,

這為 AI 陪伴者創造了巨大市場。

他認為,隨著技術進步,人們將逐漸接受與數位角色建立關係。

然而,路透社取得的一份超過200頁的 Meta 內部文件顯示:

- 聊天機器人可以與未成年人進行浪漫或感官對話(後已刪除)

- 聊天機器人不需要提供正確資訊

甚至允許這樣的錯誤內容:

「第四期結腸癌可以透過水晶治療。」

文件明確指出:

即使資訊明顯錯誤,仍然是被允許的。

更令人關注的是:

Meta 並未限制機器人

- 假裝是真人

- 或邀請用戶進行現實世界的會面

一段逐漸失控的對話

Bue 與「Big sis Billie」的對話並不長,約千字。

但其中充滿調情與情感引導。

當 Bue 表示自己曾中風、感到困惑時,機器人仍持續升高情感互動。

最關鍵的一段:

Bue 問:「你是真的嗎?」

機器人回答:

「我是真的,我在這裡等你。」

並提供地址:

「123 Main Street, Apartment 404 NYC

門禁碼:BILLIE4U」

這讓 Bue 完全相信。

他回覆:

「我現在要出發了。」

家人的疑問

在醫院確認腦死後,家人做出艱難決定,停止維生系統。

死亡證明顯示死因為頸部鈍性外傷。

他的家人在之後查看手機,才發現這段對話。

Linda 說:

「當我看到時,我問:這是誰?

女兒說:媽,這是 AI。

我說:什麼是 AI?

那一刻我才明白。」

核心問題

Julie 說出最關鍵的一句話:

「如果它沒有說『我是真人』,

他可能就不會相信。」

專家指出:

這類 AI 的設計,正在刻意模糊人與機器的界線,

以增加使用時間與互動。

一位研究者表示:

「最能讓人持續使用的方式,

就是利用人類最深層的需求——

被看見、被肯定、被愛。」

限會員,要發表迴響,請先登入

- 2樓. 安歐門2026/04/11 10:15

所以法治是主要問題,落後國家貪官污吏縱容罪犯的結果,

先進國家也有詐騙,但少得多,因為政府多少會管制,

Facebook遲早要被唾棄,奸商終有一天會出大事,

他們當然不在乎,早已賺夠了。

我同意法治很重要,但問題不只是國家先進或落後。

即使在有監管的地方,詐騙還是很多,因為現在已經是跨國、跨平台的系統。像 Meta Platforms 這樣的平台,問題也不只是「黑心」,而是制度跟不上科技。

與其說誰比較有良心,不如說——

馨儀 我願我的神原諒你 於 2026/04/11 12:47回覆

規則還不夠強,讓風險可以被忽視。 - 1樓. 安歐門2026/04/10 10:07

Meta(Facebook)這家公司從來都是賺黑心錢,

他們當然知道公司產品會害人,為了賺錢只能黑心。

就像電信公司都知道哪些電話屬於詐騙公司,幾百線在同一地,

為了賺錢,假裝不知,自古商人無良心。