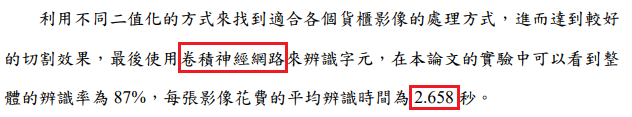

上面這篇2018年碩士論文摘要的最後一段這麼說:

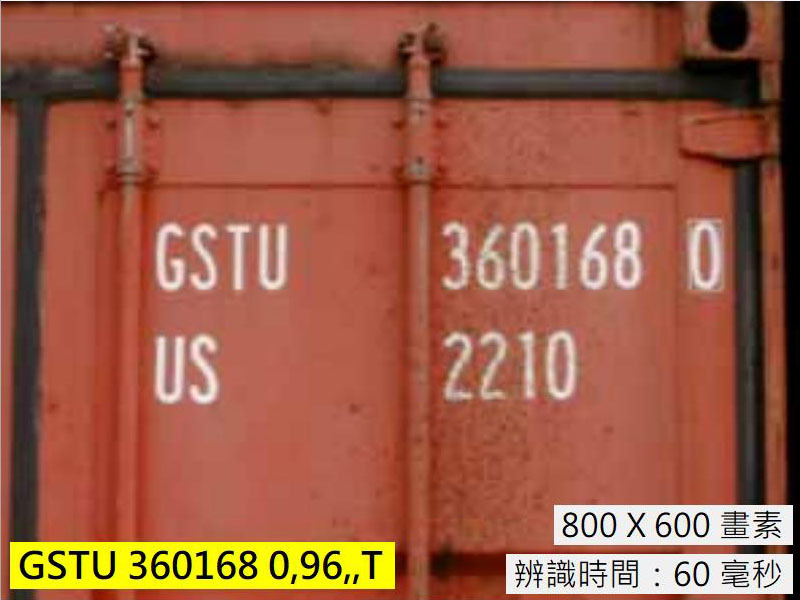

上圖是我取自上述論文中的第一個範例影像做的辨識實驗結果,該論文使用了70張影像聲稱辨識正確61張,相當好的是他在文中一一展示分析了其中失敗的九張影像的具體原因,比一般機器學習派不願意做個案分析的曖昧閃躲態度好多了!我當然也順勢拿他辨識失敗的九張做個測試,我可以辨識正確7張,只失敗2張。我的辨識率顯然比較高!當然作者只是一位碩士,我的辨識率比他好是應該的!不然我就沒資格,也沒辦法在業界靠影像辨識過活了!

我想討論的重點是他的辨識時間2.658秒就是2658毫秒,我辨識同樣一張影像的時間是如上的60毫秒,2658/60=44.3,就是速度比他的實驗快44.3倍的意思!而且完全沒用到甚麼YOLO之類的AI技術,更不需要GPU等額外的硬體協助,就可以這麼快了!我會在意追求極速當然是商業的考量!一般來說,拍照之後如果讓使用者等待超過一秒才有結果,這個產品就很難用了!即使賣出去也是會給人嫌的!辨識一個貨櫃碼要兩秒鐘以上?完全無法商品化的!

相反的,如果辨識只需不到0.1秒呢?那就是不但可以滿足客戶想要即時反應的需求,還有時間可以做很多其他功能的計算搜尋資料比對等等工作,還是可以在一秒甚至半秒內做出反應,以功能需求而論,這種效率才能叫做AI嘛!我的車載車牌辨識軟體就是反應夠快才能稱霸國內市場多年的!之前媒體說「三秒抓到贓車」?是嚴重貶低我的軟體了!事實上從影像取得→辨識成功→搜尋資料比對贓車→吐出是否贓車的結果,全程完畢只需要不到0.5秒!

這才是AI影像辨識場真實的需求與戰場,我的表現當然是OK的!AI影像辨識呢?目前還看不到有競爭力的產品!辨識一個貨櫃碼需要超過1秒,距離商品化的目標就很遠了!這就是被大家誇讚到爆的「AI」影像辨識的真實水準了!看到摘要中的關鍵字了嗎?人家可是使用最「先進」的「神經網路」也就是所謂的「AI影像辨識」做的哦!比我「不用AI」的產品慢幾十倍!

我是認真的業界RD,也已經推出貨櫃碼辨識的產品了,這種辨識貨櫃碼的論文也沒幾篇,所以當然是很認真逐字看完了!他的前半段是很傳統的OCR,後半段的文字辨識部分才使用CNN。OCR技術我很有經驗,據我的估計應該只占2.658秒計算時間的一小部分,大部分時間拖延的責任必然是CNN的過量計算所致!

但微妙的是:這篇論文的整個辨識流程中最「不需要」使用CNN的就是文字辨識的部分,因為目標是印刷字體,所以使用任何一種傳統的OCR字元比對技術都一定比CNN更快更準!如果不用CNN,2.658秒應該會變成一半或更少!而且更準!實際做過類似研究工作的人都知道的!我相信此論文的作者與指導教授也一定知道的!

那為什麼作者與指導教授(曾建誠院長)會做出這麼奇怪的選擇呢?同一位指導教授2004年就指導過另一篇類似的論文「使用影像處理技術辨認貨櫃號碼」,一樣全程辨識貨櫃碼就完全不必用CNN或ML或DL!只用傳統的影像處理技術就可以在20年前的電腦上用4~6秒辨識出一個貨櫃碼!如果同樣程式換成用2018年的i7電腦跑,絕對比2.658秒快很多的!

2004→2018有14年了欸!電腦速度絕對快很多倍了嘛!所以CNN真的讓時代倒退了!新程式比14年前的舊程式跑得還要慢?指導教授情何以堪呢?有何必要拋棄其實表現較好的OCR辨識技術,改用較複雜困難效能又較差的CNN呢?

很明顯的!這又是「為了AI而AI」的醜陋實例!我想他們師生可能也備受壓力很尷尬的!如果不硬扯上CNN怎麼申請AI補助款呢?他們是可憐的AI受害者!這很像大陸當年的文化大革命,很多其實不合理的事情只因為政治或宗教狂熱的現實難以抵抗,連最應該堅持科學精神的學術界也集體淪陷投降了!好加在我不是教授了!還能誠實的說真話!真好!

結論是用「AI」辨識是2.658秒,「不用AI」不用ML、DL與CNN辨識是0.06秒!因為這些低效率高耗能的「AI」暢行無阻,地球會因此加速暖化40多倍!你知道嗎?你不在乎嗎?

限會員,要發表迴響,請先登入