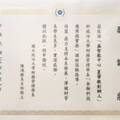

教學機器人 語音辨識技術-1

編著: 夏肇毅

初版: 2026/5/4

1.1 定義與歷史

語音辨識技術是人工智慧與語音信號處理領域的重要分支,主要研究如何將人類語音訊號轉換成文字或指令。其歷史可以追溯至20世紀50年代的早期語音機器,當時的系統只能辨識單詞或簡單命令。隨著計算能力的提升與算法進步,現代語音辨識系統能夠處理連續語音,並應用於智慧助理、語音翻譯、智能家居控制等領域。歷史上,語音辨識的發展經歷了模板匹配、統計模型(如隱馬可夫模型)、機器學習以及深度學習等階段,形成了一套完整的語音處理流程,包括語音收集、特徵提取、模型訓練和解碼。技術演進也促進了自動語音辨識(ASR)在商業及日常生活中的普及。

1.2 技術演進概述

語音辨識的技術演進主要從最初的模板匹配方法開始,這種方法將語音樣本與預先儲存的模板進行比對,但對噪音環境極為敏感,且擴展性差。後來,統計建模方法,如隱馬可夫模型(HMM)被廣泛應用,透過建立語音特徵的機率模型,提升了辨識精度。隨著計算機能力的增強,深度學習方法(例如卷積神經網路 CNN、遞歸神經網路 RNN 和長短期記憶 LSTM)成為主流,能夠自動學習語音特徵並提高對連續語音的理解能力。此外,端到端語音辨識模型和注意力機制(Attention Mechanism)也開始應用,使得模型能夠直接將語音訊號映射到文字序列,提高了系統的效率和準確性。在這個過程中,技術演進也推動了雲端語音辨識和移動端語音應用的發展。

1.3 系統架構介紹

現代語音辨識系統的架構通常分為前端處理、特徵提取、聲學模型、語言模型及解碼器五個模塊。前端處理包括噪音濾除、信號正規化等步驟,以確保後續特徵提取的準確性。特徵提取常用梅爾頻率倒譜係數(MFCC)、線性預測編碼(LPC)等方法,將原始語音訊號轉換為能夠反映語音特性的資料。聲學模型通常採用深度神經網絡(DNN)、卷積神經網絡(CNN)或遞歸神經網絡(RNN)進行訓練,並將特徵映射到音素或子詞單位。語言模型則根據上下文資訊對詞序列進行機率計算,提升辨識精度。解碼器結合聲學模型和語言模型輸出最可能的文字序列,過程中可應用 Viterbi 演算法或 Beam Search 方法。整個系統架構兼顧精度、速度與可擴展性。

1.4 應用範疇

語音辨識技術的應用範疇非常廣泛,涵蓋智慧助理(如 Alexa、Siri)、自動客服系統、語音翻譯、醫療語音紀錄、車載語音控制、教育輔助、無障礙服務等。智慧助理利用語音辨識將語音指令轉換為行動,例如設定鬧鐘或控制家電。自動客服系統可以通過辨識客戶的語音問題,快速提供相應服務。語音翻譯應用可以在跨語言交流中即時將語音轉換成文字或語音。醫療領域則可將醫師的語音診斷自動轉換為電子病歷。每個應用都需要結合語音辨識的精度、延遲和容錯能力,並在多種噪音環境中保持穩定性。隨著深度學習和邊緣運算技術的應用,語音辨識的場景將進一步拓展,尤其是在移動裝置與物聯網領域的普及。

1.5 音頻特徵提取

音頻特徵提取是語音辨識的核心步驟,旨在將語音信號轉換成可供模型處理的特徵向量。常用的方法包括梅爾頻率倒譜係數(MFCC)、線性預測編碼(LPC)、濾波器組特徵(Filter Bank Features)等。MFCC 透過模擬人耳聽覺特性,將音頻轉換為頻譜特徵,公式如下:$X[k] = \sum_{n=0}^{N-1} x[n] e^{-j 2 \pi k n / N}$,其中 $x[n]$ 為輸入訊號,$X[k]$ 為頻域表示。特徵向量通常包含 12-13 個倒譜係數以及能量特徵,用於表示語音的短時特性。此外,特徵提取過程中會進行預加重(Pre-emphasis)、分幀(Framing)與加窗(Windowing)處理,以提高辨識性能。這些特徵能有效捕捉語音的共振峰、音素變化與頻譜形態,為後續聲學模型提供可靠輸入。

1.6 頻譜分析方法

頻譜分析方法用於揭示語音信號的頻率結構,是理解語音的基礎。常用的頻譜分析方法包括傅立葉變換(FFT)、短時傅立葉變換(STFT)和功率譜密度(PSD)計算。短時傅立葉變換公式為 $X(m, \omega) = \sum_{n=-\infty}^{\infty} x[n] w[n-m] e^{-j \omega n}$,其中 $w[n]$ 為窗函數,$m$ 為時間移位。這些方法可以將語音信號從時域轉換到頻域,捕捉音素特徵及共振峰的變化,對聲學模型的訓練至關重要。頻譜分析還可幫助消除噪聲干擾,例如透過頻譜減法(Spectral Subtraction)或濾波技術來改善信號質量。頻譜特徵與語音辨識模型結合,可顯著提升辨識準確率,尤其在多噪音環境下,能維持系統穩定性。

1.7 信號降噪技術

信號降噪技術旨在提高語音辨識在噪音環境下的準確度。常用的方法包括頻譜減法、維納濾波(Wiener Filter)、深度學習去噪模型(如 Denoising Autoencoder)。維納濾波公式可表示為 $H(\omega) = \frac{S(\omega)}{S(\omega)+N(\omega)}$,其中 $S(\omega)$ 為語音信號功率,$N(\omega)$ 為噪聲功率。深度學習方法則通過學習語音與噪聲的映射關係,自動抑制背景噪聲,並保留語音信號特徵。降噪處理可在特徵提取前進行,也可與模型訓練結合進行端到端優化。有效的降噪策略能顯著降低語音辨識錯誤率,尤其在車載、工業環境及公共場所中應用時,提升系統穩定性與可靠性。

1.8 時頻轉換方法

時頻轉換方法將語音信號同時在時間和頻率兩個維度表示,以捕捉瞬時頻譜特性。常用方法包括短時傅立葉變換(STFT)、小波變換(Wavelet Transform)及希爾伯特-黃變換(HHT)。STFT 將信號分成小片段後進行傅立葉分析,公式為 $X(t, f) = \int_{-\infty}^{\infty} x(\tau) w(\tau-t) e^{-j2\pi f \tau} d\tau$,能提供時間-頻率資訊。小波變換則利用多解析度分析,適合非平穩語音信號的特徵捕捉。這些方法能有效分析語音中的瞬態資訊及共振峰變化,為聲學模型提供豐富特徵,使語音辨識在連續語音和不同噪聲環境下保持高精度。

限會員,要發表迴響,請先登入