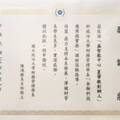

教學機器人 Python資料分析-1

編著: 夏肇毅

初版: 2026/5/10

1.1 資料分析的意義與流程

資料分析(Data Analysis)是指將原始資料轉化為有用資訊的過程,核心目標在於協助決策、發現趨勢或預測未來。Python 之所以成為資料分析的主流語言,主要是因其開源、簡潔與強大的生態系統。典型的資料分析流程包含六個階段:(1) 問題定義(Problem Definition),(2) 資料收集(Data Collection),(3) 資料清理(Data Cleaning),(4) 探索性資料分析(Exploratory Data Analysis, EDA),(5) 模型建構與驗證(Modeling & Validation),(6) 結果詮釋與視覺化(Interpretation & Visualization)。例如在銷售資料分析中,分析師會先確認目標(例如預測下季銷售量),再透過 API 或 SQL 匯入資料,接著使用 Pandas 處理缺失值與異常點。Python 在此流程中以 `numpy` 處理數值運算,以 `matplotlib` 進行圖形輸出,並以 `scikit-learn` 執行機器學習任務。完整的資料分析不僅著重演算法準確度,也需兼顧可重現性與效能管理,因此 Python 的 Notebook 形式(如 Jupyter)特別受到青睞,可讓研究者同時記錄程式、結果與說明文字。

1.2 Python在資料分析中的角色

Python 的資料分析能力來自其豐富的模組庫。`NumPy` 負責多維陣列與矩陣運算,提供高效的線性代數與隨機模擬功能;`Pandas` 則以 `DataFrame` 結構實現資料表格操作,支援索引、合併、群組、透視等功能;`Matplotlib` 與 `Seaborn` 則為資料視覺化提供多層次繪圖能力。Python 的彈性語法讓研究者能以簡短指令完成複雜任務,例如: `df.groupby(Region).mean()` 即可計算各地區平均值。Python 同時具備強大的擴充能力,可透過 `scikit-learn` 進行監督與非監督學習,或結合 `TensorFlow` 進行深度學習。由於 Python 語言接近自然語言,非程式背景的分析師也能快速上手。另一方面,Python 也能與 SQL、R、C++ 整合,並透過 RESTful API 連接即時資料來源,形成動態的分析架構。這些特性讓 Python 成為資料驅動決策的重要基礎語言,廣泛應用於金融、醫療、製造與行銷等領域。

1.3 資料分析專案的結構與管理

在專案開發中,良好的結構設計有助於維持可讀性與可維護性。典型的 Python 資料分析專案通常包含五個主要資料夾:(1) `data/` 用於存放原始資料與中介結果;(2) `notebooks/` 存放互動式分析紀錄;(3) `src/` 存放模組化的程式碼;(4) `reports/` 存放分析報告與可視化成果;(5) `config/` 放置參數設定檔。此種結構能讓團隊協作更高效,並可支援版本控制。常見分析模式包括描述性分析、診斷性分析、預測性分析與規範性分析。例如,描述性分析可用 `df.describe()` 檢視資料概況;預測性分析則可建立線性回歸模型:$y = \beta_0 + \beta_1x + \epsilon$。專案管理層面,建議採用虛擬環境(如 `venv` 或 `conda`)隔離依賴套件,並在 `requirements.txt` 中明確記錄套件版本,確保可重現性。此外,可透過 Git 與 CI/CD 管理自動化測試與部署。

1.4 實務案例:銷售資料探索

以一家電商公司為例,其希望瞭解各地區銷售趨勢並預測未來三個月營收。分析流程包括:① 資料匯入:透過 `pd.read_csv()` 將銷售紀錄載入;② 資料清理:處理缺漏與重複項;③ 探索分析:使用 `groupby()` 統計分類資料;④ 建立模型:利用 `LinearRegression()` 訓練預測模型;⑤ 結果視覺化:以 `plt.plot()` 呈現趨勢線。從資料得知,北區成長率 $\approx 12.5%$,南區僅 $\approx 4.3%$,差異可歸因於季節性促銷活動。透過建立回歸模型 $y = 0.8x + 5000$,公司可預測未來營收變化。此案例展示 Python 分析流程如何支持決策制定。

2.1 缺失值處理

資料清理是分析流程的關鍵步驟之一,因為不完整或錯誤的資料會導致模型偏誤。缺失值(Missing Values)可能來自感測器故障、問卷未填、或資料整合錯誤。處理方法分為三類:(1) 刪除法:使用 `df.dropna()` 直接移除缺失列或欄;(2) 填補法:以平均值、中位數或眾數替代,使用 `df.fillna(df.mean())`;(3) 模型預測法:利用迴歸或 KNN 模型預測缺值。選擇方法應根據資料特性與缺失比例,例如若缺失率超過30%,應重新蒐集資料。數學上,若 $x_i$ 缺失,可用 $\hat{x_i} = \mu + \epsilon$ 近似填補,其中 $\mu$ 為樣本平均,$\epsilon$ 為隨機誤差。適當的缺失值處理能提升模型精準度與穩定性。

2.2 異常值偵測與處理

異常值(Outliers)是偏離資料分佈模式的觀測點,可能源自輸入錯誤或真實罕見事件。常見偵測法有 Z-score 與 IQR。Z-score 方法以公式 $Z = \frac{x - \mu}{\sigma}$ 衡量標準差偏離,若 $|章號:Z|節號:> 3$ 則視為異常;IQR 方法則以四分位距 $IQR = Q3 - Q1$ 為基準,若資料點小於 $Q1 - 1.5IQR$ 或大於 $Q3 + 1.5IQR$,則為異常值。在 Python 中可透過 `np.where()` 或 `sns.boxplot()` 快速識別。處理策略包括刪除、替換或轉換,例如對極端值取對數可降低其影響。異常值處理需審慎評估,避免過度修剪導致資訊流失,尤其在金融欺詐或醫療異常檢測中,異常值反而可能蘊含重要訊息。

2.3 資料標準化與正規化

標準化(Standardization)與正規化(Normalization)是為使變數尺度一致而進行的轉換。標準化透過 Z-score 轉換使資料均值為0、標準差為1:$\hat{x} = \frac{x - \mu}{\sigma}$。正規化則將資料縮放至 [0,1] 區間:$\hat{x} = \frac{x - x_{\min}}{x_{\max} - x_{\min}}$。在 Python 中,`sklearn.preprocessing.StandardScaler` 與 `MinMaxScaler` 是常用工具。若不同維度的變數未經縮放,模型可能偏向數值範圍較大的特徵,導致權重不平衡。特別在距離度量(如 KNN 或 SVM)中,標準化尤為重要。正確的尺度轉換能改善模型收斂速度與精度,並使結果更具可比較性。

2.4 資料轉換與編碼

在實務應用中,分類變數需轉換為數值型態。常見方法包括標籤編碼(Label Encoding)與獨熱編碼(One-Hot Encoding)。標籤編碼將類別以整數表示,如「高」、「中」、「低」分別為 2、1、0;而獨熱編碼則為每一類別建立獨立欄位,如 `[1,0,0]` 代表「高」。在 Python 中,`pd.get_dummies()` 或 `OneHotEncoder()` 可快速實現。另一種轉換為對數或平方根,用於減少偏態(Skewness)與異常值影響。例如 $\log(x+1)$ 可使右偏分佈更接近常態。資料轉換能增強模型可讀性並提升效能,尤其在多元線性回歸或樹狀模型中,正確的編碼與轉換為模型性能的關鍵。

限會員,要發表迴響,請先登入